Nightshade : Tout savoir sur l’Outil Anti-Plagiat pour les IA Génératives

Nightshade est un outil conçu pour protéger les artistes face à l’IA. Comprenez son fonctionnement et son impact dans le domaine créatif.

Découvrez notre formation en Gen AI et exploitez tout le potentiel de la Gen AI au quotidien.

En bref : Nightshade est un outil d'optimisation offensive (data poisoning) conçu par l'Université de Chicago. Il permet aux artistes de modifier les pixels de leurs œuvres de manière invisible pour l'humain, mais radicale pour l'IA. En "empoisonnant" les données d'entraînement, Nightshade brise les corrélations sémantiques des modèles (ex: associer l'image d'un chien au mot "chat"), rendant le scraping non consenti risqué et coûteux pour les entreprises d'IA.

Imaginez. Vous êtes artiste. Vous avez passé des années à perfectionner un style unique. Un matin, vous découvrez qu'une IA peut le répliquer en quelques secondes, sans votre consentement. Face à ce "pillage numérique", la résistance s'organise. Son nom : Nightshade.

Nightshade : L'arme de la Résistance Créative face à l'IA

Imaginez. Vous êtes artiste. Vous avez passé des années à perfectionner un style unique, reconnaissable entre mille. Un matin, vous découvrez qu'une intelligence artificielle peut le répliquer en quelques secondes, sans votre consentement, pour alimenter un service commercial valant des milliards. Ce sentiment d'impuissance et d'injustice, des milliers de créateurs le vivent chaque jour.

Face à l'appétit infini des IA génératives pour les données visuelles, le droit d'auteur semble souvent dépassé. Mais face à ce qui semblait être une fatalité, la résistance s'organise. Les chercheurs du laboratoire de l'Université de Chicago ont forgé une arme numérique pour rééquilibrer les forces. Son nom : Nightshade. Le monde de l’IA générative va changer !

Dans cet article, nous allons décortiquer non seulement l'histoire de cette rébellion, mais aussi des explications simples et visuelles pour comprendre comment Nightshade et les outils similaires fonctionnent et l'impact qu'ils pourraient avoir sur le futur de l'IA.

Le Pillage Numérique : Comment les IA se Nourrissent de la Créativité

Pour comprendre la naissance de Nightshade, il faut d'abord saisir l'ampleur du problème auquel il répond. Les modèles d'IA comme Midjourney ou DALL-E ne sont pas nés "créatifs" ; ils ont été nourris avec des quantités astronomiques de données. Pour DALL-E, on parle de 250 millions d’images, cela représente près de 20 000 fois le musée du Louvre et son impressionnante collection de 12 700 tableaux.

Le "scraping" : un buffet à volonté et sans consentement

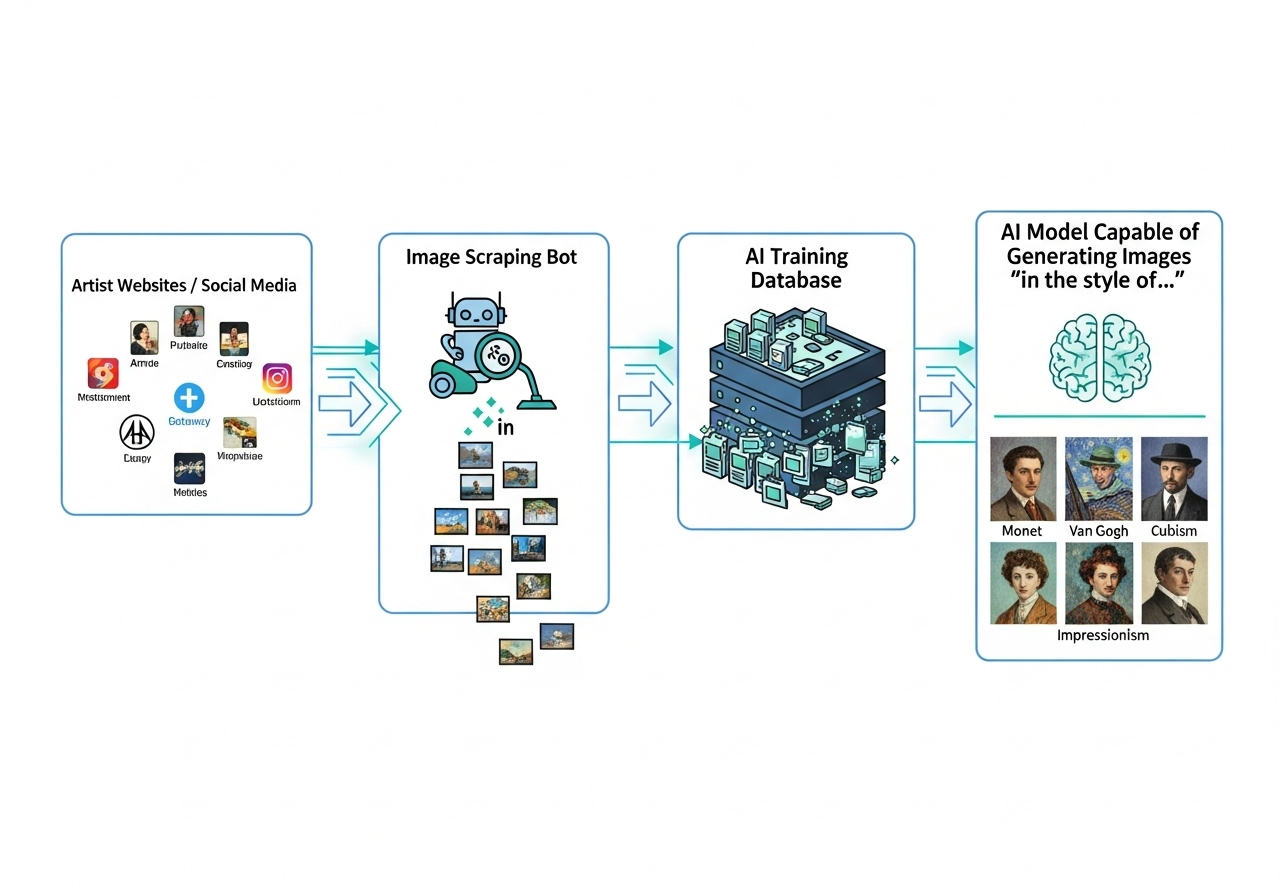

Le "web scraping" est une technique où des robots logiciels recherche sur le web et "aspirent" des milliards d'images et de textes. Pour les entreprises d'IA, Internet est devenu un immense buffet gratuit où les contenus postée sur un portfolio, un blog ou un réseau social est un plat à dévorer pour entraîner leurs modèles. Cette pratique a conduit à des actions en justice retentissantes, comme en témoigne la plainte déposée par Getty Images contre Stability AI.

L'imitation de style : plus qu'un hommage, une menace pour la survie

Le résultat le plus troublant de cet entraînement massif est la capacité des logiciels IA à isoler et répliquer le style d'un artiste spécifique. Un utilisateur peut désormais demander une image "dans le style de [nom de l'artiste]", diluant ainsi la valeur de son travail et menaçant directement l’artiste.

Flux illustré : [Sites d'artistes / Réseaux sociaux] → [Robot de Scraping aspirant les images] → [Base de données d'entraînement de l'IA] → [Modèle d'IA capable de générer des images "dans le style de..."]

La Riposte des Créateurs : Glaze et Nightshade, l'Arsenal de Protection

C'est dans ce contexte de "guerre asymétrique" que l'équipe de chercheurs du Professeur Ben Zhao de l'Université de Chicago a décidé d'agir, en développant un arsenal numérique pour les créateurs. Cet arsenal est disponible sur le site officiel du logiciel Nighshade.

Étape 1 - La Défense : Glaze, le bouclier qui protège votre style

Le premier logiciel, Glaze, agit comme un bouclier. Il applique des modifications très subtiles aux œuvres avant leur mise en ligne. Ces changements, invisibles à l'œil nu, "masquent" les caractéristiques du style de l'artiste aux yeux de l'IA. Le modèle qui scrape l'image ne pourrait donc pas apprendre à l'imiter.

Étape 2 - L'Attaque : Nightshade, l'épée qui empoisonne la source de data

Nightshade passe à l'offensive. Il ne se contente pas de protéger les œuvres; son utilisation transforme en cheval de Troie les images. C'est une épée conçue non pas pour défendre un artiste, mais pour corrompre les futurs modèles IA qui s'entraîneraient sur ces œuvres piégées.

Sous le Capot : Comment Fonctionne le "Poison" Numérique de Nightshade sur les data?

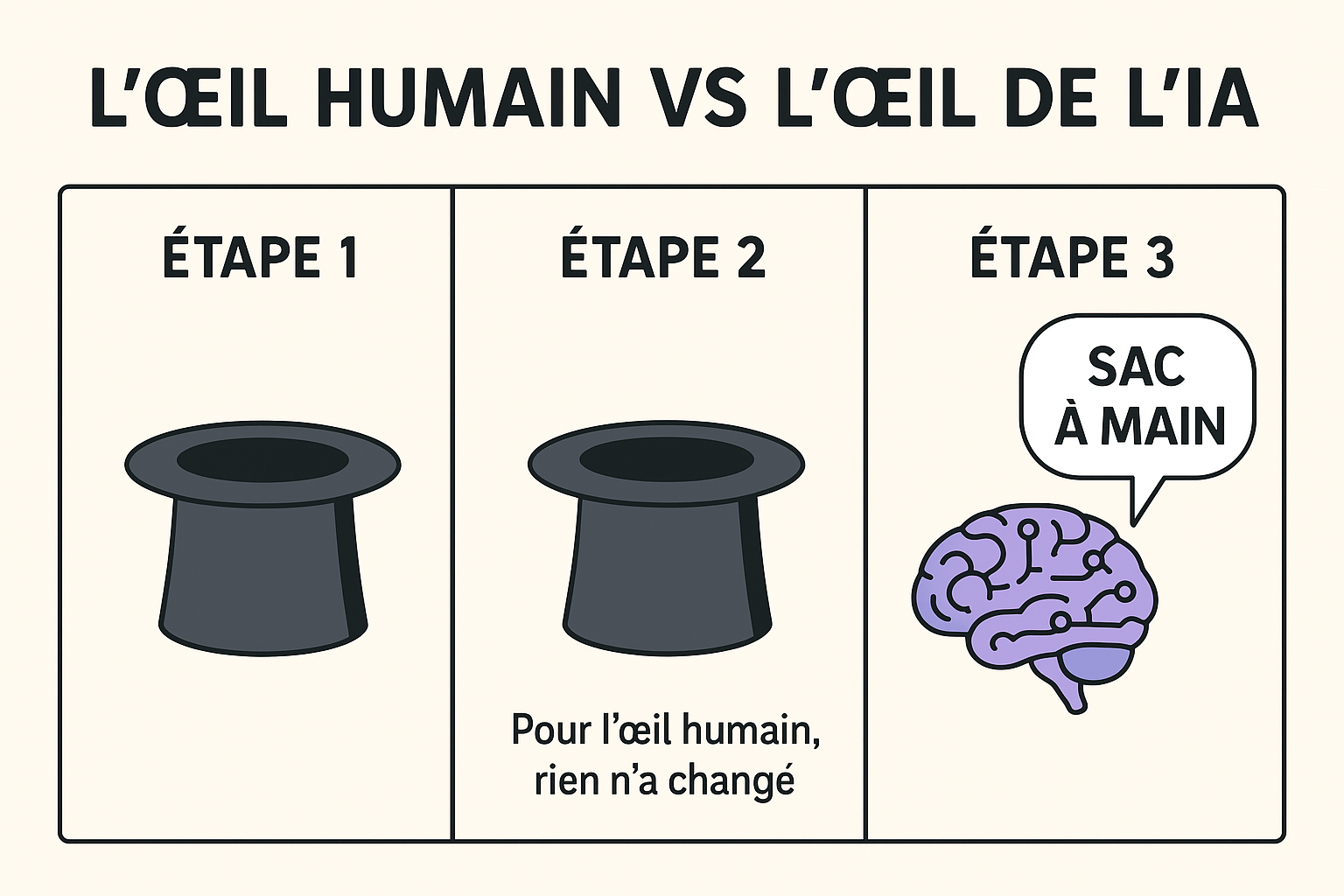

La véritable ingéniosité de Nightshade réside dans sa capacité à tromper les logiciels IA de manière ciblée et invisible. Pour les esprits les plus techniques, l'intégralité du processus est détaillée dans la publication scientifique des chercheurs. Pour les autres, voici une explication simple.

Du chien au chat : tromper l'IA sur les concepts

Imaginez que vous ajoutiez une "teinture" de pixels invisible à une photo de chien. Pour vous, c'est toujours un chien. Mais pour une IA, cette teinture lui crie "CHAT !". Si l'IA est entraînée avec des centaines de milliers de photos de chiens "empoisonnées" qui lui disent toutes "CHAT", elle finira par ne plus savoir à quoi ressemble un vrai chien. Son modèle sera corrompu.

Nightshade fait exactement cela. Il modifie les données de l'image pour que l'IA associe l'image à un concept totalement différent. Une image de dragon "nightshadée" pourrait ainsi enseigner à l'IA le concept de "voiture". Le résultat ? Un modèle qui, lorsqu'on lui demande de générer une voiture, produit des dragons.

L'Effet Papillon : Pourquoi l'Adoption Massive Peut Tout Changer

L'efficacité de Nightshade repose sur le pouvoir du nombre. Quelques images empoisonnées sont une goutte d'eau, mais des centaines de milliers peuvent rendre un jeu de data inutilisable, coûtant des millions de dollars en re-nettoyage aux entreprises d'IA.

C'est un appel à une action collective. Ce mouvement est d'ailleurs soutenu par des institutions reconnues, comme l'a montré la Société des Auteurs dans les Arts Graphiques et Plastiques (ADAGP) en France, qui encourage les artistes à utiliser ces outils.

Une Victoire Définitive ? Limites, Débats et l'Avenir de la Guerre Créative

Nightshade n'est pas une solution miracle, mais un puissant levier de pression.

- La course à l'armement : Les géants de l'IA pourraient développer des contre-mesures pour détecter et filtrer les images empoisonnées, créant un jeu du chat et de la souris technologique.

- Une arme légitime ? L'idée "d'empoisonner" des données soulève des questions éthiques, mais les créateurs de l'outil la présentent comme un acte de légitime défense face à un scraping non consenti.

- Au-delà des outils : La solution pérenne se trouve certainement dans la loi. Les outils tels que Nightshade servent à faire pression pour accélérer la mise en place d'un cadre légal protégeant les artistes. C'est un sujet dont se sont emparées les plus hautes instances, comme le U.S. Copyright Office américain avec son initiative sur l'IA.

Vers une utilisation plus responsable des IA génératives

Des outils comme Nightshade rappellent que le développement des IA génératives ne se limite pas à des enjeux techniques. Ils soulèvent des questions essentielles de respect des données, de propriété intellectuelle et de responsabilité dans l’usage des modèles.

C’est cette approche technique, critique et responsable que nous abordons dans nos formations, afin d’aider à construire des usages de l’IA à la fois efficaces, durables et respectueux des cadres existants.

Conclusion : Plus qu'un Outil, un Symbole de Reprise en Main

Nightshade est bien plus qu'une innovation. C'est un changement de paradigme. Pour la première fois, les artistes disposent d'un moyen de riposte concret qui leur redonne du pouvoir et fait peser un risque direct sur ceux qui exploitent leurs œuvres sans permission.

La bataille pour des logiciels IA éthiques et respectueux des artistes ne fait que commencer, mais l'équilibre des forces a changé grâce aux chercheurs derrière le logiciel Nightshade. Désormais, pour les entreprises d'IA, chaque image sur le web n'est plus seulement une ressource potentielle, mais aussi un risque. Et c'est peut-être ça, la plus grande victoire de Nightshade.

Comment faire pour se former à l'IA générative ?

Chez DataBird, nous ne nous contentons pas de vous montrer comment générer du contenu. Nous vous apprenons à décoder la mécanique profonde des modèles, des enjeux de l'entraînement jusqu'aux problématiques de protection des données. L'IA est un outil puissant, mais sa maîtrise nécessite de comprendre ses failles et ses cadres légaux pour l'intégrer durablement dans vos processus.

Si vous voulez transformer l'IA générative en un levier stratégique tout en maîtrisant ses aspects techniques et éthiques, notre Formation à l'IA générative (Gen AI) est faite pour vous. Pensée pour les professionnels, elle vous donne les clés pour piloter ces outils avec expertise et discernement.

{{formation-gen-ai="/brouillon"}}

Les derniers articles sur ce sujet

IA et Ressources Humaines : pourquoi former vos équipes en 2026 ?

.webp)

.jpeg)